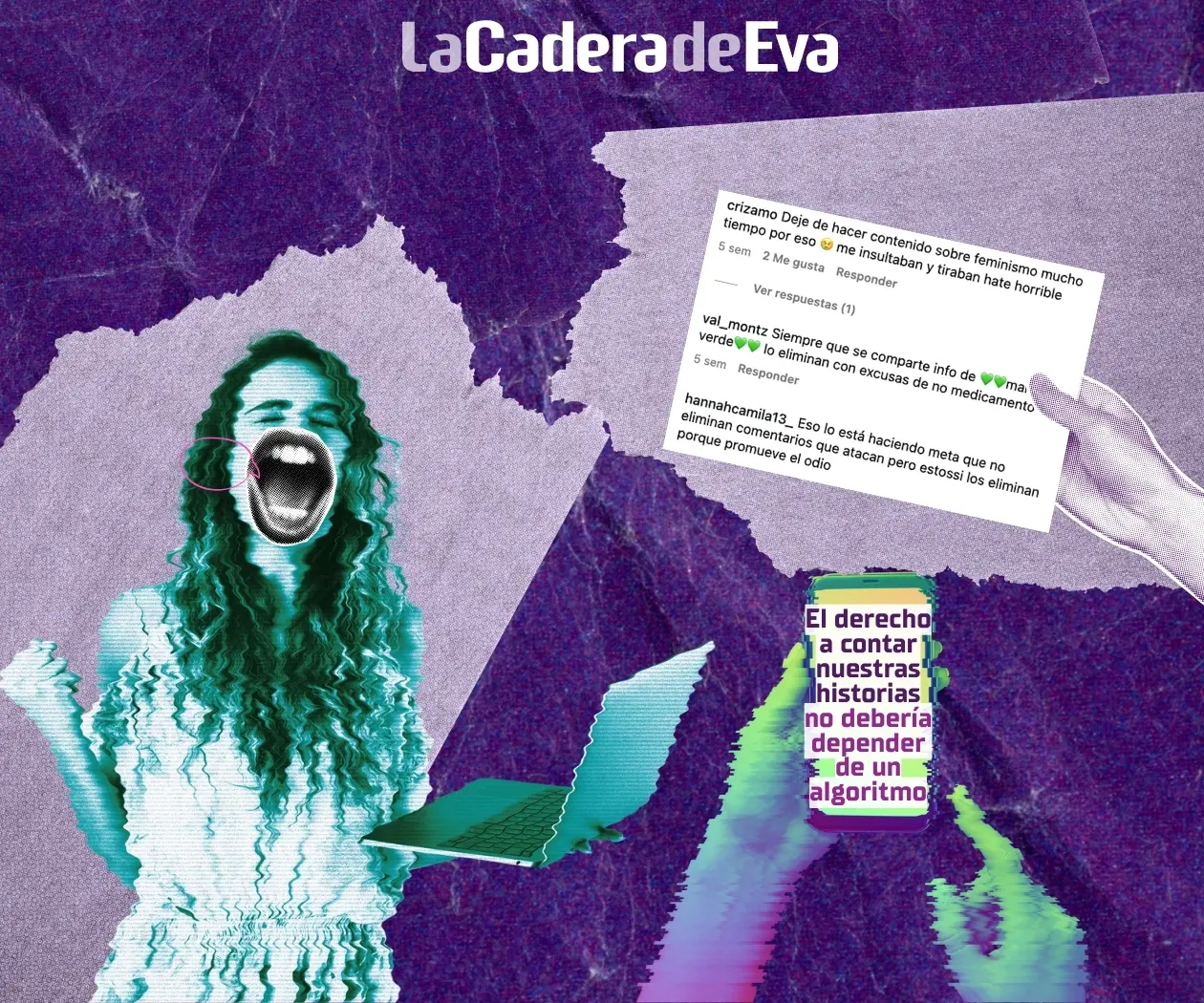

“Tu publicación ha sido eliminada por incumplir las normas de la comunidad”. Ese mensaje se repite una y otra vez para periodistas, creadoras y defensoras que comparten contenido feminista en redes sociales. Denunciar un feminicidio, hablar de aborto seguro o cuestionar el machismo puede significar que tu voz quede borrada, oculta o castigada por los algoritmos.

En La Cadera de Eva iniciamos la investigación “Censura algorítmica: cómo las redes castigan el contenido feminista”, para documentar cómo estas prácticas afectan a mujeres y colectivas en México, América Latina y el Caribe.

¿Qué entendemos por censura algorítmica?

El concepto censura algorítmica surge de la literatura académica crítica que estudia cómo las plataformas digitales restringen contenidos de manera automatizada: borrados, bloqueos, limitaciones de alcance o desmonetización. No se trata de “errores”, sino de decisiones algorítmicas que impactan de manera desigual.

Investigaciones previas muestran que los contenidos feministas y de derechos humanos son penalizados con más frecuencia, mientras que expresiones violentas, machistas o discriminatorias permanecen visibles.

¿Qué sabemos que se ha documentado?

- Periodistas y creadoras feministas han denunciado la eliminación sistemática de publicaciones sobre violencia de género, aborto legal o diversidad sexual.

- En América Latina, colectivas y defensoras han visto reducido el alcance de sus cuentas tras denunciar feminicidios o compartir información sobre derechos reproductivos.

- Un reportaje de AP News documentó cómo Meta ha eliminado información sobre aborto en México, dificultando que las mujeres accedan a recursos seguros en línea.

- Estudios académicos y periodísticos muestran que los algoritmos reproducen sesgos estructurales, amplificando discursos de odio y silenciando voces disidentes.

Incluso ya existen herramientas y recursos para profundizar en este fenómeno, como la Guía para investigar los algoritmos de las redes sociales de Global Investigative Journalism Network.

¿Y el algospeak?

Frente a esta censura, muchas personas usuarias han creado estrategias para “engañar” a los algoritmos. Una de ellas es el algospeak, que consiste en modificar palabras sensibles —por ejemplo escribir “seggs” en vez de “sexo” o “ab0rt0” en vez de “aborto”— para evitar que el contenido sea detectado y borrado.

Si bien el algospeak permite que ciertos mensajes circulen, también muestra el nivel de vigilancia y control algorítmico al que estamos sujetas/os, y cómo se restringe el debate público sobre derechos.

Una investigación con apoyo de ARTICLE 19

Este proyecto forma parte de la beca Guardianxs de Internet 2.0 de ARTICLE 19, que impulsa iniciativas en defensa de los derechos digitales y la libertad de expresión en línea.

Además de entrevistas con especialistas y defensoras, lanzamos una encuesta confidencial para recopilar experiencias directas de quienes han enfrentado esta forma de censura digital. Con esa información buscamos construir evidencia y abrir un debate urgente sobre cómo los algoritmos afectan la libertad de expresión feminista.

Si quieres participar en la encuesta da click aquí

Por:

Por: